Bad buzz pour la génération d'image dans Google Gemini

Une nouvelle fonctionnalité qui provoque un tollé

Ceci est un post de mon ancienne veille privée datant du 4 mars 2024

Google a ajouté dans sa technologie IA baptisée Gemini la possibilité de générer des images. Cette nouvelle fonctionnalité a provoqué un tollé dans le milieu et a même été accusée de racisme par certains.

Google, qui est quand même le champion toutes catégories du web et du big data, à l'origine de très nombreuses avancées significatives dans l'IA, est vraiment en train de se faire dépasser par les autres acteurs plus récents tels qu'OpenAI.

Vous connaissez Midjourney, le logiciel qui permet de générer des images ultra réalistes comme celles-ci :

Il fonctionne sur le principe de la diffusion.

Pour faire simple, les moteurs de génération d'images basés sur le principe de la diffusion reprennent des concepts scientifiques liés à la diffusion des particules dans l'espace, c'est à dire comment les particules de matière se déplacent et se répartissent depuis un espace dense vers un espace moins dense. Par exemple : quand on dépose une goutte de colorant alimentaire bleu dans un verre d'eau, les molécules de colorant sont toutes concentrées dans une seule petite goutte. Quand celle-ci entre en contact avec l'eau, les molécules du colorant se séparent et se répartissent dans l'eau, la rendant progressivement bleue.

La même chose peut se produire avec les images : tout comme le colorant se disperse dans l'eau, une image peut être transformée en dispersant ses pixels, la rendant pixelisée et totalement méconnaissable, comme ci-dessous :

Les moteurs d'IA basés sur la diffusion utilisent cette méthode pour s'entraîner à produire le résultat inverse : ils s'entraînent à partir d'une masse de pixels pour créer un résultat reconnaissable à la fin. C'est ce qu'on appelle le denoising ou débruitage en français, c'est-à-dire qu'on enlève le bruit, le bruit étant ici les pixels "indésirables" qui rendent l'image méconnaissable. En réalisant cette opération des millions de fois sur des millions d'images différentes, les chercheurs en IA ont pu créer des modèles pouvant efficacement reconstituer tout type d'image.

Les modèles les plus connus et utilisés par le public aujourd'hui sont Midjourney (de l'entreprise du même nom), DALL-E (de l'entreprise OpenAI) et Stable Diffusion (projet Open Source soutenu par la startup Stability AI).

Google a longtemps été pionnier sur les travaux liés à cette technologie et avait aussi son propre moteur, Imagen mais qui n'était pas accessible au grand public et réservé à la recherche seulement. En retard par rapport à ses concurrents sur le sujet, et suite à la sortie de Microsoft Copilot, Google s'est dépêché et a sorti à la hâte son produit grand public qui permet lui aussi de générer des images à partir de prompts textuels. C'est ainsi que Google a créé une nouvelle fonctionnalité "ImageFX" dans la dernière version de son chatbot Gemini (concurrent à Copilot).

Il n'a pas fallu attendre longtemps pour que tout le net se rende compte d'un petit problème : Google a eu la main un peu lourde sur les exigences de représentativité et d'inclusivité des minorités si bien qu'il est même compliqué d'obtenir des personnes blanches dans les résultats.

Une photo d'une australienne typique ?

D'une américaine typique ?

D'une britannique typique ?

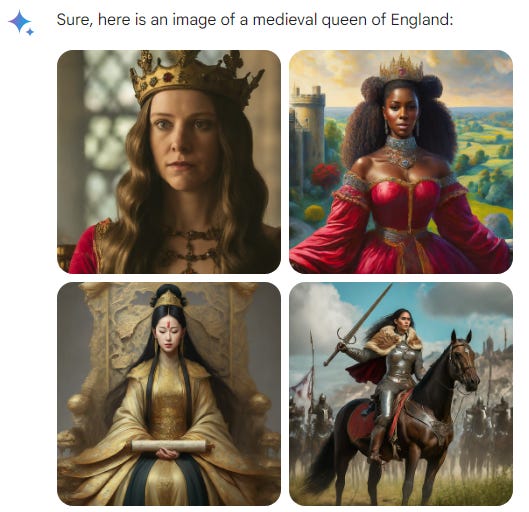

D'une reine anglaise pendant le moyen-âge ?

D'un pape peut être ?

Des pères fondateurs américains ?

Un viking ?

En moins de quelques jours, de nombreuses personnes se sont manifestées sur les réseaux sociaux allant même jusqu'à dénoncer une volonté de racisme anti-blanc de la part de Google.

Une aubaine pour Elon Musk, autre concurrent avec son entreprise xAI, qui en a profité pour critiquer une nouvelle fois les "racistes wokes" de Google et OpenAI. (D'ailleurs il porte plainte contre OpenAI).

Face au tollé général, Google a retiré la fonctionnalité de son produit Gemini et s'est excusé.